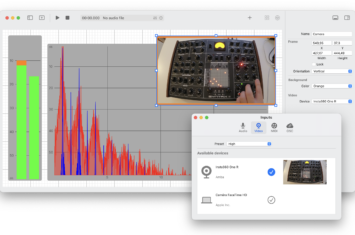

Capture, analyse et modélisation de processus audionumériques en musicologie

- On 15 avril 2024

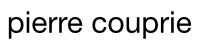

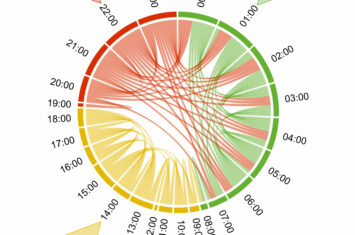

Conférence et publication dans le cadre des Journées d’informatique musicale (6-8 mai 2024). Renseignements : https://jim2024.sciencesconf.org. Cet article présente le développement de la version 6 du logiciel iAnalyse, qu’il met en perspective avec notre pratique de la musicologie numérique. Le contexte scientifique est décrit à partir de la mutation de l’écoute et de l’analyse musicales en […]

Read More